Originariamente, il termine slop si riferisce al mucchio di fanghi che gradualmente ricopre il fondo dei serbatoi delle navi, in particolare delle petroliere, ha scritto il Courrier International lo scorso giugno. Da diversi mesi il termine viene utilizzato anche per designare i contenuti di fascia bassa generati dall’intelligenza artificiale e che inondano sempre più il web.

Non contento di inquinare Amazon Books e Youtube (compresi i canali di filosofia, ha recentemente osservato Phi), lo slop invaderebbe anche la piattaforma di blogging Medium. WIRED afferma infatti di aver chiesto alla società Pangram Labs, specializzata nella rilevazione dell'intelligenza artificiale, di analizzare un campione di 274.466 articoli recenti, pubblicati nell'arco di sei settimane sulla piattaforma.

La start-up, che presenta la propria tecnologia come “ più accurato per rilevare contenuti generati dall'intelligenza artificiale su larga scala “, con un tasso di precisione di ” più del 99,98% “, ha stimato che oltre il 47% di essi è stato probabilmente generato dall'intelligenza artificiale (GenAI).

WIRED ha chiesto a una seconda start-up, anch'essa dedicata al rilevamento di contenuti GenAI, Originality AI, di confrontare due campioni di post Medium, uno risalente al 2018, l'altro di quest'anno. Il 3,4% del primo era stato probabilmente generato dall'intelligenza artificiale.

Una percentuale che corrisponde alla percentuale di falsi positivi dell'azienda, precisa il suo amministratore delegato John Gillham, soprattutto perché gli strumenti di intelligenza artificiale non erano ancora ampiamente utilizzati. Al contrario, poco più del 40% del campione del 2024 è stato probabilmente generato dall’intelligenza artificiale.

Il 7% degli articoli di notizie sono generati dall'intelligenza artificiale

« Sono due ordini di grandezza in più rispetto a quello che vedo sul resto di Internet “, racconta Max Spero, CEO di Pangram, a WIRED. Nel mese di agosto, la start-up aveva infatti analizzato 857,43 articoli pubblicati su 26.675 siti di informazione in un solo giorno lo scorso luglio, e aveva scoperto che 59.653 di essi, ovvero il 6,96%, erano stati, in tutto o in parte (dal 50 al 100% ), scritto da AI.

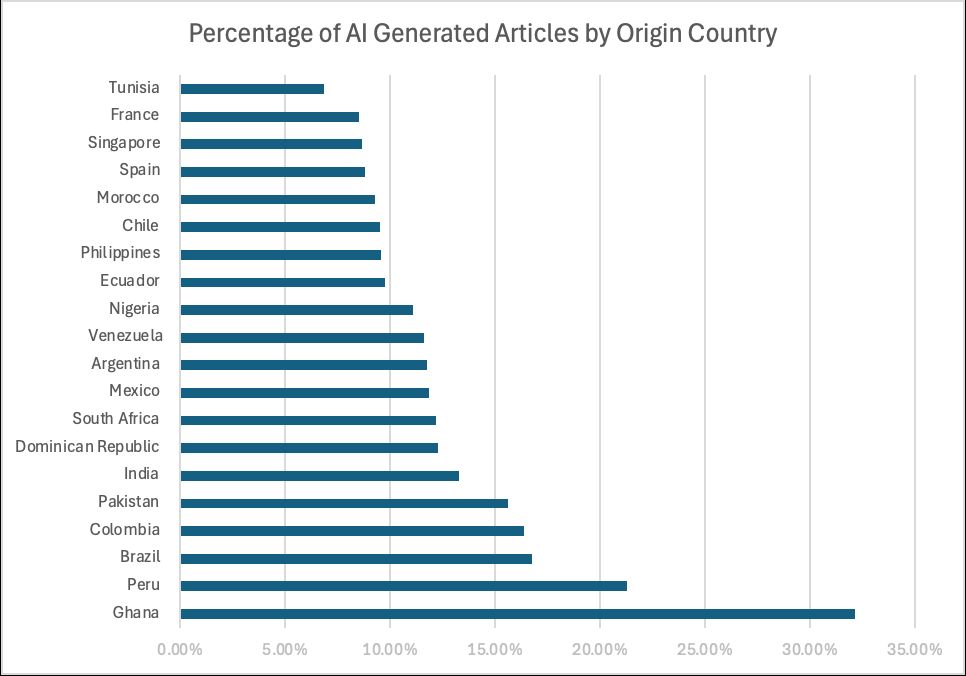

Il Ghana è in cima alla lista dei paesi che utilizzano maggiormente l’IA, con quasi il 33% degli articoli GenAI, seguito da Perù (oltre il 20%), Brasile, Colombia e Pakistan (16%). Se la Francia (8%) si colloca al penultimo posto della classifica, subito dietro Singapore e Spagna, quest'ultima ha menzionato principalmente paesi del Sud America, Africa occidentale e Asia meridionale, e nessun altro paese europeo o nordamericano.

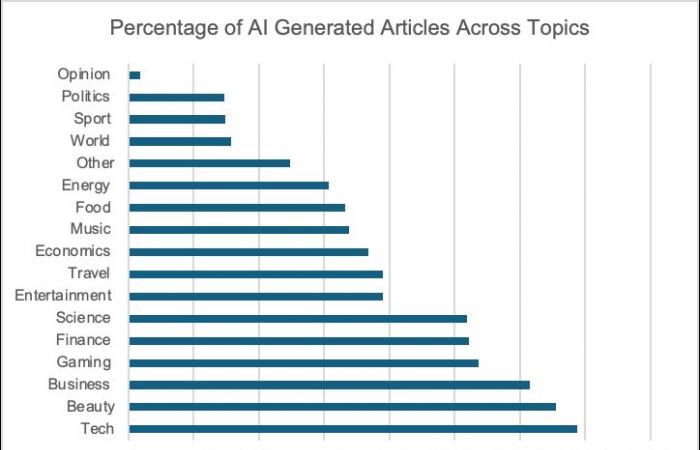

La tecnologia è arrivata in testa tra i temi più inquinati dai contenuti GenAI, davanti a bellezza (a causa degli articoli sponsorizzati), business, gaming, finanza e scienza, soprattutto in relazione alle truffe legate ai crypto-asset.

Putaclics invita alla pubblicità e alle truffe crittografiche

Pangram aveva identificato diversi tipi di articoli GenAI. Alcuni mirano solo a soddisfare “ siti progettati per la pubblicità » (siti realizzati per la pubblicità o MFA) al fine di attirare i lettori ed esporli a pubblicità di fascia bassa.

Il loro contenuto quindi non è “ non è proprio pensato per essere letto ”, ma solo per attrarre clienti, soprattutto attraverso i titoli “putaclics”. Inoltre, gli inserzionisti non sono consapevoli di visualizzare i propri annunci su questi siti di fascia bassa. Pangram stima che gli MFA rappresentino circa il 50% dei contenuti GenAI.

La società ha inoltre osservato che un “ gran parte » gli articoli sul tema della bellezza erano infatti “sponsorizzati”, e quindi scritti da comunicatori ed editori che subappaltavano la scrittura di tali contenuti alle AI. Allo stesso modo, molte istruzioni per l’uso legate a nuovi cripto-asset si rivelano truffe, la cui scrittura è nuovamente affidata all’intelligenza artificiale.

Il 78% degli articoli taggati NFT, web3 ed Ethereum erano GenAI

Su Medium, 4.492 dei 5.712 articoli (o il 78%) taggati NFT erano stati probabilmente generati anche dall'intelligenza artificiale. Una proporzione sproporzionata che Pangram ha osservato anche in articoli etichettati web3, Ethereum, “AI” e… animali domestici.

McKenzie Sadeghi, redattore di NewsGuard, una società di monitoraggio della disinformazione online che ha identificato più di 1.000 siti web di notizie GenAI, ha scoperto che la maggior parte di questo tipo di contenuti riguardava criptoasset, marketing e ottimizzazione dei motori di ricerca (SEO).

Anche i numerosi resoconti che sembrano aver pubblicato volumi significativi di documenti generati dall'intelligenza artificiale sembrano riguardare solo un numero limitato, se non nullo, di lettori, osserva WIRED. Un account segnalato da Pangram Labs come autore di diversi articoli dedicati alle criptovalute ne ha pubblicati sei in un solo giorno, ma senza alcuna interazione, suggerendo un impatto trascurabile.

Al contrario, WIRED ha anche scoperto che altri articoli contrassegnati da Pangram, Originality e dalla società di rilevamento AI Reality Defender come probabilmente generati dall'intelligenza artificiale avevano centinaia di “applausi”, simili ai “Mi piace” che troviamo su altre piattaforme, ma senza sapere se provenissero da umani o robot.

Medium è fatto per la narrazione umana, non per gli articoli GenAI

« Medium funziona essenzialmente grazie alla cura umana “, ribatte Tony Stubblebine, amministratore delegato della piattaforma, riferendosi ai 9.000 redattori capo delle pubblicazioni Medium, nonché alla valutazione umana aggiuntiva degli articoli che potrebbero essere “potenziati” artificialmente.

Se riconosce che i contenuti GenAI sono pubblicati su Medium” è probabilmente decuplicato dall’inizio dell’anno “, si oppone tuttavia all'uso dei rilevatori di intelligenza artificiale per valutare la portata del problema, anche perché ritiene che non sia possibile distinguere tra messaggi generati interamente dall'intelligenza artificiale e messaggi in cui l'intelligenza artificiale viene utilizzata in modo più leggero (cosa che il CEO di Pangram rifiuta, per inciso).

A differenza di LinkedIn e Facebook, che incoraggiano esplicitamente l’uso dell’intelligenza artificiale, Medium non consente più articoli GenAI. “ Medium è destinato alla narrazione umana, non alla scrittura generata dall'intelligenza artificiale », Ha sottolineato la piattaforma sul suo blog l'anno scorso. “ La stragrande maggioranza delle storie rilevabili generate dall'intelligenza artificiale nei feed grezzi per questi argomenti ottiene zero visualizzazioni », aggiunge Stubblebine.

« Man mano che gli strumenti di intelligenza artificiale generativa diventano sempre più comuni, le piattaforme che rinunciano a cercare di eliminare i bot incuberanno un mondo online in cui il lavoro creato dall’uomo diventerà sempre più difficile da trovare su piattaforme sopraffatte dai bot », conclude WIRED, facendo eco alla teoria della Internet morta.

Etichettata come teorica della cospirazione, sostiene che Internet è praticamente popolata solo da bot e che la maggior parte dei contenuti è generata da algoritmi, marginalizzando l’attività umana.